En un agradable día de primavera a principios de abril de 1993, tres amigos de 30 años se sentaron a charlar en el restaurante del vecindario Denny's en East San José, la capital no oficial de Silicon Valley: Jensen (Jen-heson según los dictados taiwaneses) Huang, un ejecutivo de LSI Logic, fabricante y desarrollador de sistemas de almacenamiento y redes de comunicación de datos; Chris Malchowsky, ingeniero de Sun Microsystems; y Curtis Priam, ex ingeniero senior de IBM y Sun Microsystems y experto en diseño y desarrollo de chips para cálculos gráficos.

¿Su objetivo? Mostrar a sus empleadores (que pronto serán los primeros) la dirección en la que se dirige el mundo de la computación, rico en gráficos y con poderes computacionales nunca antes vistos. Hace 30 años es importante mencionar que casi no había Internet, ni smartphones, las aplicaciones estaban diseñadas para el trabajo de oficina, y en casa la computadora se usaba en la gran mayoría de los casos para juegos, escritura de documentos de Office, música (MIDI) o diseño gráfico. Los cálculos gráficos pesados, como el diseño de productos o los dibujos industriales y de ingeniería, requerían el uso de supercomputadoras fabricadas por compañías como Silicon Graphics, Scitex de Israel o la propia Sun Microsystems.

Huang y sus colaboradores veían el futuro de manera diferente: computación potente basada en centros de datos en lugar de procesadores de computadora. En otras palabras, supercomputadoras. Querían ejercer este poder utilizando un tipo relativamente nuevo de chip, los procesadores gráficos. Una vez más, hoy en día las tarjetas gráficas son un chip básico en cualquier ordenador, smartphone o consola, pero hace 30 años eran un producto muy de nicho. Muy pocos se han utilizado, tal vez para la edición de películas o la producción de videos animados por computadora. Fueron prediseñados para usos tales como mejorar la visualización en juegos de computadora o consolas. Pero se les llamaba "subprocesadores", lo que significa que sólo ayudaban al procesador principal en los cálculos gráficos. Pero Huang y sus socios fueron más allá, creyendo que estos chips podrían reemplazar procesadores tradicionales como Pentium de Intel o PowerPC, Motorola e IBM de Apple.

"Las GPU proporcionan una potencia computacional mucho mayor que los procesadores normales", dice Or Danon, CEO de la startup israelí de chips de IA Hailo. "Los cálculos gráficos requieren mucha potencia porque calcular una pantalla es una tarea muy pesada", añade. Huang vio esto como el futuro. "Creíamos que este modelo de computación podría resolver problemas que las computadoras de propósito general no pueden", dijo a Forbes en 2011. Huang decidió que los videojuegos y los juegos eran el modelo de negocio que le permitiría a él y a sus socios financiar la investigación y el desarrollo para la producción de chips que podrían abordar problemas computacionales mucho más grandes, desde la simulación hasta los cálculos estadísticos para la inteligencia empresarial.

Los nuevos socios no tenían mucho dinero, un total de alrededor de u$d 40,1995 en conjunto. Tampoco tenían un nombre para la compañía. "No podíamos pensar en un buen nombre, así que llamamos a todos nuestros archivos NV o próxima versión (la próxima versión, un nombre genérico en el desarrollo de software y hardware para futuras versiones de tecnologías)". Al enviar los artículos de incorporación tenían que encontrar un nombre para ponerles, así que buscaron todas las palabras con este par de letras y encontraron la palabra latina invidia, o envidia. Dos años más tarde, la compañía lanzó su primer chip gráfico para juegos, el NV3. Como era de esperar, no fue un gran éxito. Era un buen momento para los juegos, las tecnologías 90D comenzaron a penetrar en el campo y Nvidia tenía muchos competidores, por ejemplo, ATI (ahora parte de AMD y todavía el principal competidor de Nvidia en tarjetas gráficas) y 3DFX (adquirida por Nvidia).

El acelerador para todas estas empresas fue una nueva tecnología lanzada por Microsoft, Direct3D, una interfaz de software (API) que hizo posible producir fácilmente gráficos 10D en PC domésticos. Preste atención a esto, porque 3 años después Nvidia también hará el mismo movimiento tecnológico que será una parte importante de convertirlo en lo que es hoy. En cualquier caso, a pesar del relativo fracaso del primer modelo, la compañía no se desesperó y continuó desarrollando y mejorando sus chips gráficos durante varios años, con las ventas mejorando cada año y competidores desapareciendo lentamente.

El año 1999 fue un muy bueno para Nvidia. Hizo dos movimientos, el primero fue una oferta pública inicial en Nasdaq y el segundo fue el lanzamiento de su línea de productos más conocida: chips GeForce y RIVA TNT. La primera marca es familiar para todos los jugadores de hoy, pero tomó algún tiempo antes de que se apoderara del mundo. Durante varios años, ATI continuó siendo el principal rival hasta su adquisición por AMD. Lo importante de los chips GeForce era que eran los primeros de su tipo. Hasta entonces, los chips servían como contraayuda al procesador principal de la computadora. Los chips GeForce fueron los primeros en incluir un procesador gráfico dedicado (GPU) en su arquitectura. Otro movimiento ingenioso de Nvidia fue venderlos directamente a los fabricantes de tarjetas gráficas para que los empaquetaran y los vendieran bajo una marca independiente. Bastantes OEM taiwaneses como Asus o Acer se han construido de esta manera. Estos chips eran tan buenos que los vendió a Microsoft para la primera Xbox y Sony cambió a la PlayStation 3. En 2006 llegó el siguiente paso importante: el lanzamiento de CUDA, una arquitectura de computación paralela que transformó instantáneamente los chips gráficos de Nvidia en chips que podrían usarse para cualquier tarea informática complicada. Esto es lo que realmente lo sacó de los mundos de los juegos y lo llevó a los mundos de la computación de alta potencia (HPC).

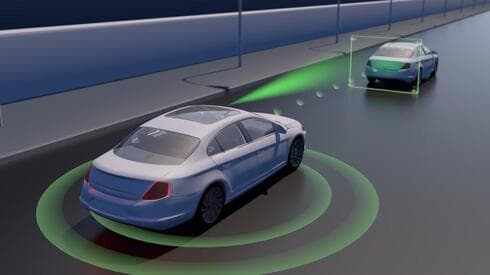

Pero no todo fue color de rosa estos años. Nvidia se perdió una revolución importante, la del móvil. Aunque, para su crédito, no fue la única en perdérselo. Intel tampoco entendió muy bien la magnitud de la hora y se está lamiendo las heridas hasta el día de hoy. Pero para Nvidia era menos importante. Lanzó una plataforma de chips llamada Tegra, que realmente no interesó a los fabricantes de móviles, excepto a un número muy pequeño de ellos. Pero la compañía sabe cómo hacer limonada con limones, y en 2014 Tegra se convirtió en una plataforma para vehículos. También opera serpentinas, equipos industriales y más. Tegra era originalmente un procesador gráfico móvil, un chip muy eficiente energéticamente, pero también era exactamente lo que necesitaba la industria automotriz o la maquinaria industrial. Un chip pequeño, potente y económico para cálculos de IA. Huang se dio cuenta rápidamente de que la inteligencia artificial y los autos sin conductor eran el futuro. Sólo que él no sabía cuándo sucedería. Ha estado hablando de ello durante años, al menos 15, si no más. Un portavoz de una compañía de semiconductores muy grande y competidora bromeó diciendo que recicla sus afirmaciones en cada informe trimestral.

Nvidia ha realizado una gran cantidad de movimientos en los últimos años que la han puesto en el lugar correcto, en el momento adecuado y con el producto adecuado para la próxima revolución tecnológica: la entrada de la inteligencia artificial en todos los ámbitos de nuestras vidas. Basta con mencionar los siguientes números: ChatGPT fue entrenado en 10.000 chips gráficos Nvidia en un marco de supercomputadora que Microsoft construyó para sí misma. El costo promedio de cada chip oscila entre u$d 10.000 y u$d 25.000. Sólo de este acuerdo generó al menos u$d 100 millones, y no es que haya muchas compañías en la industria que puedan competir. "Nvidia posee alrededor del 90% del mercado", dijo a Ynet Moshe Tanach, cofundador y CEO de Neureality y ex ejecutivo de Intel y Marvell. En otras palabras, cada vez que una empresa quiere entrenar un modelo de IA, debe usar los chips de Nvidia. "Lo que ha logrado hacer es proporcionar una plataforma completa basada en CUDA, que permite a cualquier persona que quiera desarrollar aplicaciones de IA hacerlo de manera conveniente y eficiente", explica Tanach.

En 2001, Huang se tatuó el logotipo de estilo tribal de la compañía en el hombro. "Lloré como una niña", recuerda años después. Probablemente sea uno de los pocos CEO de la generación de más de 60 años en la industria de semiconductores que camina con un tatuaje del logotipo de su compañía. Esto fue dos años después de la OPI. Una década después, las acciones de la compañía ya habían cruzado la marca de los 100 dólares. Este año ya supera a Intel, AMD, Meta y otros gigantes tecnológicos en camino al exclusivo club de los mil millones. También es la única compañía de chips que ha logrado ingresar y más con un producto único como chips de inteligencia artificial y supercomputadoras. En el camino, también adquirió Mellanox de Israel. Sin embargo, según Tanach, la adquisición de Mellanox sólo lo ayudó a avanzar, pero eso no es lo que lo convirtió en lo que es hoy.

El secreto de Nvidia parece estar en la visión de Huang y sus socios. La terquedad y la comprensión de que incluso si otros realmente no notan el futuro, tienes que crear una meta y luchar por ella. El mercado de chips gráficos se ha vuelto muy importante gracias a su capacidad para usarlos para todo tipo de tareas, desde extraer Bitcoin, ejecutar videojuegos, configurar supercomputadoras para la industria, los gobiernos y la academia, como Israel One, la supercomputadora que la compañía está construyendo para sí misma en Israel, pero también su capacidad para proporcionar un paquete completo de herramientas que ayudan a los desarrolladores a usar sus chips para las diversas tareas que se les exige. Ahora la compañía también está operando en el campo de la realidad aumentada y virtual y la robótica con plataformas similares a estos campos. No es por nada que Meta creó una supercomputadora Nvidia diseñada para impulsar el metaverso de Zuckerberg, entre otras cosas.

Nvidia es difícil de evitar hoy en día, y competidores como Intel y AMD tendrán muchas dificultades para lidiar con ella en los próximos años. Pero eso no significa que sea imposible. "Nvidia es muy fuerte en el entrenamiento de modelos de IA", dice Or Danon, "pero realmente no vale la pena en el campo de la inferencia (la operación de modelos de IA en tareas en curso, R.K.)". En otras palabras, Nvidia también tiene un talón de Aquiles que los competidores inteligentes, eficientes y ágiles pueden explotar. Sin embargo, en los próximos años, Nvidia probablemente seguirá siendo la compañía de tecnología más importante para la inteligencia artificial.